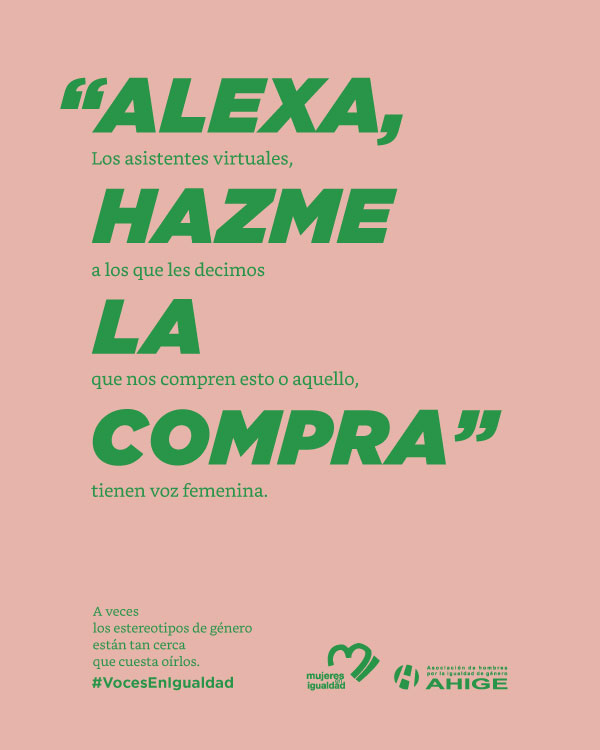

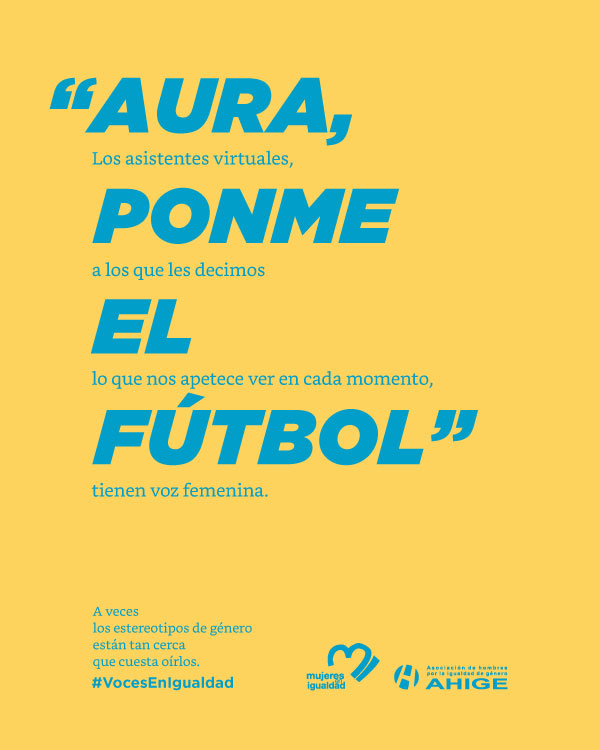

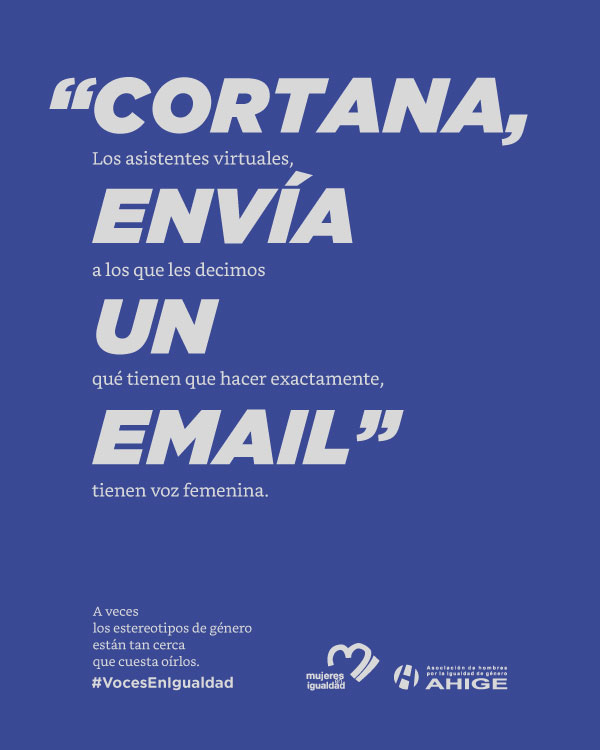

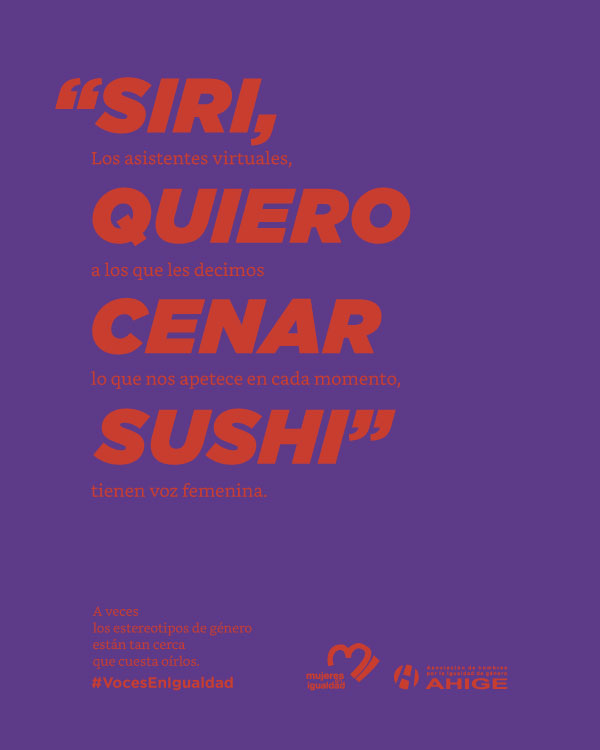

A finales del año pasado, coincidiendo con la aparición en el mercado español de Amazon Echo y de su asistente virtual Alexa, la agencia Tangoº lanzaba una campaña para denunciar el machismo que se esconde tras la cotidianidad de pedirle algo a Siri, Alexa y otros asistentes.

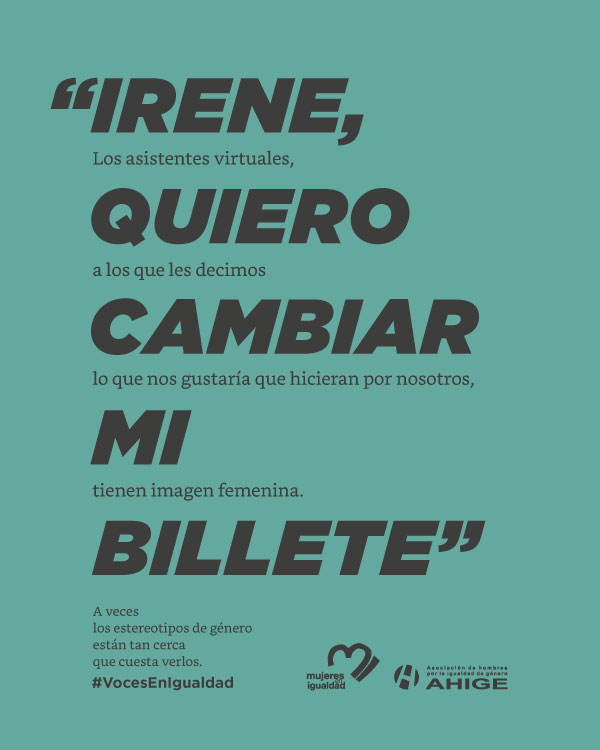

A raíz de la campaña de Tangoº se han instaurado pequeños cambios, como la inclusión de asistentes masculinos por parte de Renfe o Correos

De esta manera se generó una conversación tras la que se logró que Correos empezara a trabajar en un asistente para su web de género masculino, que se llamará Alberto, por ejemplo. O que Renfe añadiera la opción de solicitar a Martín cualquier información, como alternativa a su famosa Irene.

Ahora es la UNESCO la organización que asegura que Siri, Alexa, Google o Cortana perpetúan estereotipos de género. En uno de los capítulos del estudio elaborado para EQUALS con el título “Me sonrojaría si pudiera: cerrando divisiones de género en habilidades digitales a través de la educación” examina cómo los asistentes virtuales basados en Inteligencia Artificial pueden estar perpetuando estereotipos de género. Y es que, aunque es posible configurarlos con voz masculina, la que viene determinada por defecto es la de mujer.

La publicación de este informe demuestra que la vía de conversación abierta hace meses a través del hashtag #VocesEnIgualdad y en colaboración con las asociaciones Mujeres en Igualdad y Hombres por la Igualdad de Género (AHIGE) está más viva que nunca.

Más info.: I'd blush if I could: closing gender divides in digital skills through education